新しいAIモデルは、1枚の画像から話すアバターを製作することができます。開発者は、このモデルをレオナルド・ダ・ヴィンチやモナリザなどの人気絵画に適用しました。

その成果は、いくつかの視覚的な不具合はあるものの、これまでの技術よりもはるかに印象的なものでした。

ディープフェイク(人工知能による人間の画像合成技術)を生成するソフトウェアは、リアルな偽造品を作るために大量の画像セットを必要とします。近年のニューラルネットワークの進歩により、幅広いデータセットでネットワークを学習させることで、非常にリアルな人間の画像が得られることがわかってきました。

しかし、モスクワにあるサムスンの研究センターの開発者は、このたび、1枚の画像から会話するアバターを作成できる新しい人工知能(AI)モデルを開発しました。1枚の画像からビデオクリップを作成することは可能ですが、複数の画像を使ってトレーニングを行うことで、識別性の保持やより高いリアリティが得られます。

このモデルで生成されたトーキングヘッドは、ワーピングベースのシステムの能力を超えた様々なポーズに対応しています。多少の不具合はあるかもしれませんが、従来の技術とは比較にならないほど素晴らしい結果が得られています。このモデルは、最終的に本物の映像と見分けがつかないようなマルチメディアの作成につながります。

困難な点

リアルなおしゃべりアバターの制作は、主に以下の2つの理由から困難です。

人間の頭部は、運動学的、幾何学的、そして写真学的に非常に複雑です。髪の毛、目、口など様々な要素を正確にモデリングする必要があります。視覚システムの鋭さは、人間の頭部をモデル化する際の外観上の小さな誤差に関わります。

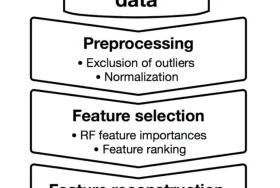

これらの問題を解決するために、新しいAIモデルは、学習過程で3つのニューラルネットワークを作成します。まず、顔のランドマークとなるフレームをベクトルで結ぶ埋め込みネットワークを構築します。次に、ランドマークを合成されたクリップにマッピングするためのジェネレータネットワークを構築します。最後に、識別器ネットワークがフレームのポーズとリアリズムを評価します。

顔のランドマークと動きをよりよく理解するために、研究者たちは、YouTubeにアップされた何千もの人間が話している動画を使ってニューラルネットワークを学習させました。そして、その結果(トーキングヘッド)を、別のニューラルネットワークと定量的に比較しました。

結果

研究チームはこのモデルを、モナリザ、レオナルド・ダ・ヴィンチ、アルバート・アインシュタインなど、多くの人気者の画像に適用しました。その結果、1枚の画像から対話形式の動画を作成し、古典的な肖像画に命を吹き込むことに成功しました。

1枚の写真だけで動画を作ることができます。しかし、32枚の写真で学習したモデルは、より優れたパーソナライゼーション・スコアと完璧なリアリズムを達成することができます。

このタイプのAIは、マルチプレイヤーゲーム、ビデオ会議、さらには特殊効果産業を含むテレプレゼンスにおいて、いくつかの実用的な応用が可能です。

一方で、このような技術の急速な発展は、誤報、なりすまし、不正、選挙の改ざんなどのリスクを高める可能性があります。